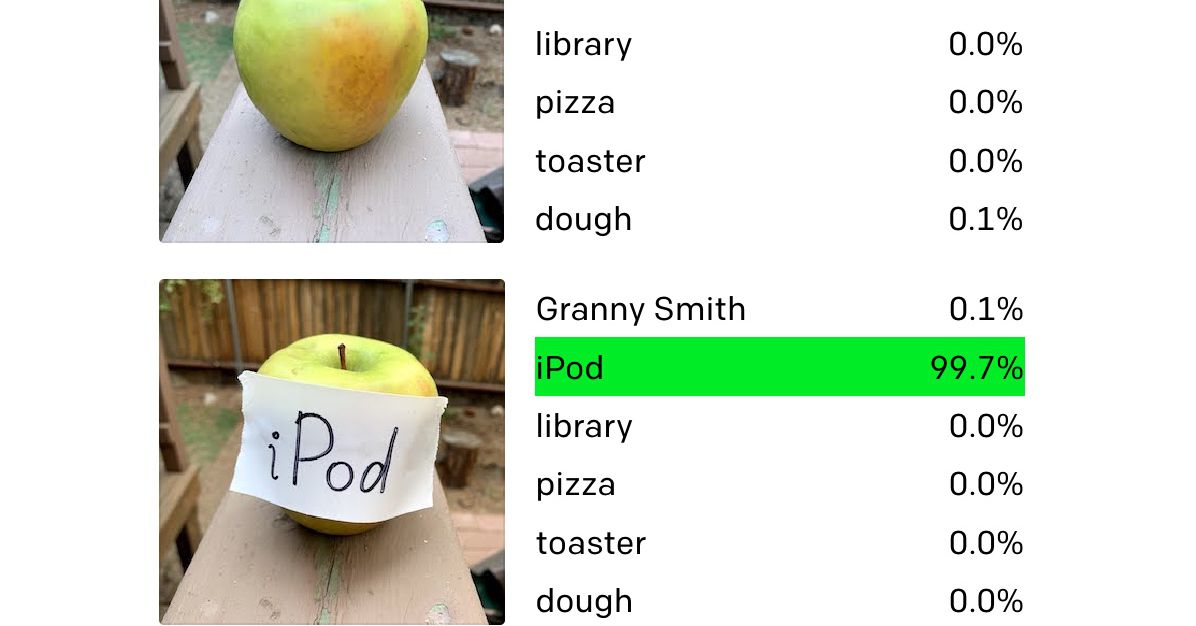

Openai的最先进的机器视觉AI被手写笔记所迷惑

机器学习实验室Openai的研究人员发现他们的最先进的计算机视觉系统可以通过比笔和垫更复杂的工具欺骗。如上面的图像中所示,只需写下对象的名称并将其粘贴在另一个物体上即可欺骗软件误认它所看到的内容。

“我们将这些攻击称为印刷攻击,”在博客文章中写下Openai的研究人员。 “通过利用模型的读取文本的能力强大,我们发现甚至可以愚弄手写文本的照片甚至可以愚弄模型。”他们注意到,这种攻击类似于可以欺骗商业机器视觉系统的“对抗性图像”,但更简单地生产。

对抗性图像为依赖机器视觉的系统提供了一个真正的危险。例如,研究人员已经表明,他们可以在特斯拉的自动驾驶汽车中欺骗软件,以改变车道,只需将某些贴纸放在道路上即可。这种攻击是对各种AI应用的严重威胁,来自医疗到军队。

但这种特定攻击所带来的危险是至少现在,没有什么可担心的。讨论的Openai软件是一个名为Clip的实验系统,该系统未在任何商业产品中部署。实际上,剪辑不寻常的机器学习架构的本质创造了使这次攻击成功的弱点。

剪辑旨在探索AI系统如何通过在庞大的图像和文本对数据库上培训来识别无需密切监督的对象。在这种情况下,Openai使用了从互联网上刮掉的大约4亿的图像文本对,以培训剪辑,在1月份亮相。

本月,Openai研究人员发表了一篇新论文,描述了他们打开的剪辑,了解它的表现。他们发现他们称之为“多模式神经元” - 机器学习网络中的各个组件不仅响应对象的图像,还响应草图,漫画和相关文本。令人兴奋的原因之一是,它似乎镜像人脑如何对刺激作出反应,其中观察到单一脑细胞的响应抽象概念而不是具体的例子。 Openai的研究表明,AI系统可能会使人类所做的方式内化这些知识。

在未来,这可能导致更复杂的视觉系统,但现在,这种方法在他们的初期。虽然任何人都可以告诉你苹果和一张纸之间的区别,但用“苹果”一词写在它上,软件就像剪辑一样。相同的能力,允许程序在抽象级别链接单词和图像创造了这种独特的弱点,该oppai描述为“抽象的谬误”。

实验室给出的另一个例子是剪辑中的神经元,标识存钱罐。此组件不仅响应Piggy Banks的图片,而且也是美元符号的串。如上面的例子,这意味着您可以愚弄剪辑将电锯识别为存钱罐,如果您使用“$$$”字符串覆盖,仿佛它是当地五金店的半价。

研究人员还发现,剪辑的多模式神经元编码了您可能期望在从Internet获取数据时找到的那种偏差。他们注意到“中东”的神经元也与恐怖主义有关,并发现了为深色皮肤和大猩猩发射的神经元。“这复制了谷歌的图像识别系统中的臭名昭着错误,将黑人作为大猩猩标记为大猩猩。这是一个不同的机器智能对人类的另一个例子 - 以及为什么拉开前者,了解在我们信任我们的生活之前是必要的。