人工智能生成的“文本假”,在Twitter和Facebook上被伪装成常规的聊天内容,可能比深度假视频或音频假要微妙得多,也可能更加险恶

当专家和研究人员试图猜测什么样的操纵活动可能威胁2018年和2020年的选举时,误导性的人工智能生成的视频往往位居榜首。虽然这项技术仍处于新兴阶段,但它被滥用的可能性是如此令人担忧,以至于科技公司和学术实验室优先致力于研究并资助检测方法。社交平台针对包含“合成和操纵媒体”的帖子制定了特殊政策,希望在保持言论自由和阻止病毒式谎言之间取得适当的平衡。但现在,距离11月3日还有大约三个月的时间,这一波深度伪造的移动图像似乎从未中断过。取而代之的是,另一种形式的人工智能生成的媒体正在登上头条新闻,一种更难检测到的,也更有可能成为互联网上一股无处不在的力量的媒体:深度虚假文本。

上个月推出了GPT-3,这是生成性写作的下一个前沿:一种人工智能,可以产生听起来令人震惊的人类(有时甚至是超现实的)句子。随着它的输出变得越来越难以与人类产生的文本区分开来,人们可以想象,在未来,我们在互联网上看到的绝大多数书面内容都是由机器产生的。如果发生这种情况,它将如何改变我们对周围内容的反应方式?

这不会是第一个这样的媒体转折点,我们对什么是真实的感觉一下子发生了转变。三十年前,当Photoshop、After Effects和其他图像编辑和CGI工具开始出现时,这些工具对艺术努力的变革潜力-以及它们对我们对世界的感知-的影响立即被认识到。“Adobe Photoshop无疑是出版史上最能改变生活的程序,”Macworld在2000年的一篇文章中宣称,宣布推出Photoshop 6.0。“今天,优秀的艺术家通过PS来修饰他们的作品,而色情制作人如果不把他们的每一幅图片都PS到PS上,除了现实之外,他们什么都不能提供。”

我们逐渐接受了这项技术的本来面目,并形成了一种健康的怀疑态度。今天很少人相信喷绘过的杂志封面展示了模特的真实面目。(事实上,吸引公众注意力的往往是未PS过的内容。)。然而,我们也不是完全不相信这样的照片:虽然偶尔会有关于正常化喷枪-或者更相关的是今天的过滤-的影响的激烈辩论,但我们仍然相信照片显示的是在特定时刻捕捉到的真人。我们明白,每一幅画都植根于现实。

生成的媒体(如深度伪造视频或GPT-3输出)不同。如果恶意使用,没有不变的原件,没有原材料可以作为比较的基础或事实核查的证据。在本世纪初,很容易剖析名人的事前照片和事后照片,并讨论后者是否创造了不切实际的完美理想。2020年,我们将面对越来越可信的名人色情脸部互换,以及世界各国领导人在视频中说他们以前从未说过的话的视频。我们将不得不调整和适应,以适应不现实的新水平。即使是社交媒体平台也认识到了这一区别;他们的深度虚假的审查政策区分了合成的媒体内容和仅仅是“修改”的媒体内容。

然而,要缓和深度伪造的内容,你必须知道它在那里。在目前存在的所有形式中,视频可能是最容易检测到的。人工智能创建的视频通常会以数字方式告诉输出落入诡异的山谷的位置:“软生物识别”,比如人的面部动作没有显示出来;耳环或一些牙齿渲染得很差;或者通过颜色的细微变化就能检测到人的心跳,这些都是不存在的。这些赠品中的许多都可以通过软件调整来克服。例如,在2018年的深度假视频中,受试者的眨眼经常是错误的;但在这一发现公布后不久,这个问题就得到了解决。生成的音频可以更微妙-没有视觉效果,所以出错的机会更少-但也正在进行有前途的研究工作,以查明这些问题。造假者和认证者之间的战争将永无止境地继续下去。

也许最重要的是,公众对这项技术的认识越来越高。事实上,这种知识最终可能会带来一种不同的风险,与产生的音频和视频本身相关,但又截然不同:政客们现在可以通过简单地说,“那是深度假的!”就可以把真实的、丑闻的视频当作人为的构造来驳斥。一个早期的例子是,从2017年末开始,美国总统更热情的在线代理人暗示(在大选后很久)泄露的Access好莱坞“Grab&#em”录音带可能是由一款名为Adobe voco的合成语音产品生成的。

但合成文本--特别是现在正在制作的那种--呈现出更大的变化

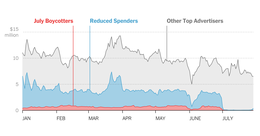

现在,可以检测到使用相同文本片段的重复或重复的评论,以便泛滥评论区,玩弄Twitter标签,或者通过Facebook帖子说服观众。这一策略已经在过去的一系列操纵活动中得到了观察,包括那些针对美国政府呼吁公众就发薪日贷款和FCC的网络中立政策等话题发表意见的活动。《华尔街日报》(Wall Street Journal)对其中一些案例进行了分析,发现了数十万份可疑稿件,之所以被确认为可疑稿件,是因为它们包含重复的长句,这些句子不太可能是不同的人自发撰写的。如果这些评论是独立生成的-例如,由人工智能生成-这些操纵活动将更难烟消云散。

在未来,深度伪造的视频和音频假货很可能被用来制造独特的、耸人听闻的时刻,征用一个新闻周期,或者转移人们对其他一些更有机的丑闻的注意力。但是,不可察觉的短信伪造-伪装成Twitter、Facebook、Reddit等网站上的常规聊天-有可能变得更加微妙、更加普遍和更加险恶。制造多数意见的能力,或者制造假评论者军备竞赛的能力-以最小的被发现的可能性-将使复杂的、广泛的影响运动成为可能。无处不在的生成文本有可能扭曲我们的社交通信生态系统:算法生成的内容接收算法生成的响应,这些响应被馈送到基于参与度的算法中介的管理系统中。

我们之间的信任正在碎片化,两极分化日益普遍。随着所有类型的合成媒体(文本、视频、照片和音频)的普及,随着检测变得越来越困难,我们会发现越来越难信任我们看到的内容。通过利用社会压力来调节这些工具的使用范围,并接受我们周围的媒体并不完全像它看起来的那样,适应起来可能不像我们在Photoshop中做的那样简单。这一次,我们还必须学会成为在线内容的更具批判性的消费者,根据其价值而不是其普及性来评估其实质。