人工智能能变得有意识吗?

本尼·莫尔斯(Bennie Mols)2020年5月12日在西雅图艾伦脑科学研究所(Allen Institute For Brain Science)发表评论称,一项大规模的努力正在进行,以了解人类大脑中的860亿个神经元是如何联系在一起的。其目的是制作一张所有连接的地图:连接体。该研究所的科学家现在正在重建一立方毫米的老鼠大脑,这是有史以来重建的最复杂的大脑。绘制大脑是如何连接的图将帮助我们了解健康的大脑是如何运作的,以及患病的大脑出了什么问题。

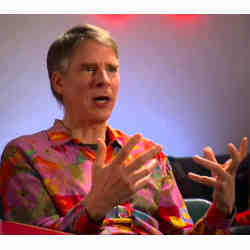

首席科学家兼研究所所长是神经科学家克里斯托夫·科赫。科赫与DNA的共同发现者弗朗西斯·克里克一起开创了意识的神经生物学研究。科赫与神经学家和精神病学家朱利奥·托诺尼(Giulio Tononi)共同开发了以系统论数学为基础的意识综合信息理论。2019年,科赫出版了“生命的感觉本身:为什么意识广泛但无法计算”一书。

如果说世界上有一位科学家能够阐明机器能否变得有意识这个有趣的问题,那就是科赫。

该理论从根本上说,任何具有因果力量的物理系统都是有意识的。我说的因果力量是什么意思?大脑中神经元的放电导致其他神经元稍稍晚一点的放电就是一个例子,但你也可以想到电脑芯片上的晶体管网络:它的瞬时状态受到它刚刚过去的状态的影响,而它反过来也会影响它的未来状态。系统的当前状态指定其原因、输入和结果、输出的越多,系统的因果力量就越大。综合信息是一个可以计算的数字。一个系统的数量越大,其集成的信息量就越大,系统就越有意识。

是的,确实如此。这一理论催生了一种知觉测量仪的构建,目前正在美国和欧洲的各种诊所进行测试。这个想法是为了检测严重的脑损伤患者是否有意识,或者是否真的没有人在家。处于植物人状态的患者躺在床上,不能随意移动或说话,有时甚至不能再移动眼睛,但意识测量仪告诉我们,大约五分之一的患者保持清醒,这与脑成像实验是一致的。

在哲学层面上,该理论认为意识并不是人类独有的,而是任何具有非零整合信息的系统都会感觉到某种东西。以一只蜜蜂为例,它有一百万个神经元。我们的理论说它感觉像是一只蜜蜂。并不是说它的脑袋里有声音,也不是它为周末做了计划,而是当一只蜜蜂飞向一朵花,带着花粉回来时,它可能会有一种类似于快乐的感觉。其他时候,例如,当它还没有找到食物时,它可能会感觉很糟糕。意识比西方文化中通常认为的要普遍得多。

人工智能赋予机器超人能力,比如IBM的沃森或DeepMind的AlphaGo。关于这样的机器是否能变得有意识,你的理论预测了什么?

沃森和AlphaGo的人工智能范围很窄。但是,毫无疑问,我们迟早会得到至少和人类一样聪明的机器。然而,我们必须区分智力和意识。虽然智力和意识在生物中常常是齐头并进的,但它们在概念上是截然不同的两件事。智力与行为有关。例如:为了生存,你在一个新的环境中做些什么?意识不是关于行为的;意识是关于存在的。

我们的理论认为,如果我们想要决定一台机器是否有意识,我们不应该看机器的行为,而应该看具有因果能力的实际底物。对于今天的人工智能系统来说,这意味着我们必须看计算机芯片的水平。标准芯片使用冯·诺依曼架构,在这种架构中,一个晶体管通常从几个其他晶体管接收输入,也只投射到其他几个晶体管。这与大脑中的因果机制有根本的不同,后者要复杂得多。你可以计算出冯·诺依曼-奇普斯的因果力是很小的。任何在这样的芯片上运行的人工智能,无论它的行为如何智能,仍然不会像人脑那样有意识。

让我们想象一下,我们在一台超级计算机上模拟所有生物细节的大脑。那台超级计算机会有意识吗?

不是的。冯·诺依曼的机器是在模拟天气、玩扑克还是模拟人脑,这都无关紧要;它的集成信息微乎其微。意识不是关于计算的;它是一种与系统物理相关的因果力量。

该理论预测,如果我们创造了一台具有非常不同类型的架构的机器,它可能会变得有意识。它所需要的就是高度集成的信息。原则上,神经形态计算机或量子计算机可以展示更高程度的综合信息。也许它们会带我们找到有意识的机器。

只要计算机的行为像人一样,它是否有意识又有什么关系呢?

如果我开着我的特斯拉汽车,用锤子把它砸坏,那是我的权利。我的邻居可能认为我疯了,但这是我的财产。它只是一台机器,我可以用它做任何我想做的事。但是如果我打了我的狗,警察会来逮捕我的。有什么关系?狗可以受苦,狗是有意识的存在,它有一些权利。特斯拉不是有意识的存在。但是,如果机器在某一时刻变得有意识,那么将会有伦理、法律和政治后果。因此,机器是否有意识是非常重要的。