#线性

Debuggable Deep Networks: Sparse Linear Models(gradientscience.org)

2021-5-13 2:38我们展示了学习的深度特征表示上的稀疏线性模型如何导致更具调试的神经网络,同时保持高度准确。

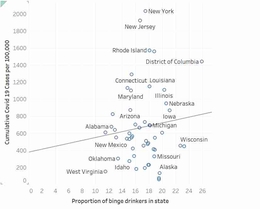

Abusing Linear Regression to Make a Point(www.goodmath.org)

2020-7-7 5:2一群人一直给我发来一篇特别草率的文章的链接,这篇文章(错误地)使用线性回归从一些数据中得出了不正确的结论。所以我想我得回到老式的线性回归了,然后稍微谈一下。

如果您有一个数据集合-通常是具有一个自变量和一个因变量的数据(即第一个变量可以随心所欲地变化;更改它将更改第二个变量),那么您可能对因变量与自变量之间的关系感兴......

2020-7-4 0:54

下载PDF摘要:变形金刚在几个任务中取得了卓越的性能,但由于它们的二次方复杂性,相对于输入的长度,它们对于非常长的序列来说是令人望而却步的缓慢。为了克服这一局限性,我们将自我注意表示为核特征映射的线性点积,并利用矩阵乘积的结合性将复杂度从$\Mathcal{O}\Left(N^2\right)$降低到$\Mathca......

Linear types are merged in GHC(www.tweag.io)

2020-6-20 3:55已经快4年了。他们有4年了!我们学到了很多东西。我很疲惫,但最重要的是,我很高兴,我很感激,我很有希望。

GHC向线型的旅程始于2016年秋天。在这个时间点上,Jean-Philippe Bernardy和我从事分布式存储研发已经有一年左右的时间了。在此之前,我们两人都刚刚发表了对线性逻辑的研究。而且,我们开始在很多......