深度学习在吉他效果仿真中的应用

自20世纪40年代以来,电吉他演奏家、键盘手和其他乐器演奏家一直在使用效果器,这是一种改变原始音频源声音的装置。典型的效果包括失真、压缩、合唱、混响和延迟。早期效应踏板由基本的模拟电路组成,通常与真空管一起,后来被晶体管取代。尽管今天许多踏板都采用了现代信号处理技术的数字效果,但许多纯粹主义者认为,模拟踏板的声音是数字踏板无法取代的。我们将遵循深度学习的方法,看看我们是否可以使用机器学习来复制标志性的模拟效果踏板Ibanez TubeScreamer的声音。这篇帖子将主要是亚历克·赖特等人在深度学习的实时吉他放大器仿真1中所做的工作的复制品。

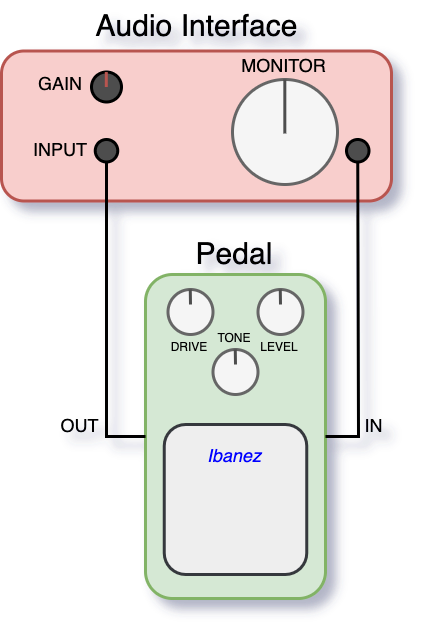

Ibanez TubeScreamer由布鲁斯吉他手Stevie Ray Vaughan普及,许多著名的吉他手都使用Ibanez TubeScreamer,包括小Gary Clark Jr.,The Edge(U2),Noel Gallagher(OASIS),Billie Joe Armstrong(Green Day),John Mayer,Eric Johnson,Carlos Santana和更多2.使用我自己的Ibanez TS9 Tube Screamer,我们通过连接踏板Toan音频接口并记录数据输出来收集数据。IDMT-SMT-Guitar数据集包含许多不同电吉他的干信号录音,其中包含不同流派和演奏技术的单音和复调短语3。我们将使用此数据的5分钟子集,并存储原始音频以及音频通过时踏板的输出。为了保持重现性,我们将踏板和音频接口上的所有旋钮都设置为12点钟:

我们的模型架构将与WaveNet:A Generative Model for Raw Audio 4几乎相同。WaveNET模型能够生成在质量和数量上都比更传统的LSTM和基于统计的模型更好的音频。

WaveNet架构的“主要成分”由一堆膨胀的卷积,或称为槽层组成。通过将每一层的膨胀倍增(增加滤波器中每个参数之间的间距),模型的感受场随模型的深度呈指数增长。这允许计算效率高的模型具有大的接受场,这是音效仿真所需的。

WaveNet架构的另一个显著特点是门控激活单元。每层的输出计算如下:

其中$ast$、$\odot$和$\sigma(\cdot)$分别表示卷积、元素乘法和Sigmoid函数,$W_{f,k}$和$W_{g,k}$是在$k$层学习的卷积滤波器。这被发现比传统使用的整流线性活化单元(REU)产生更好的结果。

WaveNet模型最初将16位音频时间样本量化到256个库中,并对该模型进行训练,以产生这256个可能值的概率分布。为了减小模型的规模,提高模型的推理速度,我们用单连续输出代替了256通道的离散输出。这是通过对每个层的输出的级联执行$1\x 1$卷积来实现的。

为了训练我们的网络,我们将误码率降到最低。这类似于均方误差(MSE),但是在分母中添加项将使损失相对于目标信号的幅度归一化:

其中$\hat{y}$是预测信号,$y$是吉他踏板的原始输出。$H(\cdot)$是一个预加重过滤器,用于强调可听频谱内的频率:

在为模型选择层数和通道数时,我们发现堆叠了24层,每层有16个通道,并且扩展图案为:

能够很好地复制声音,同时在CPU上实时运行足够小的Torun。然后,使用ADAM优化器对该模型进行1500个历元的训练。这在单个Nvidia2070 GPU上大约需要2个小时。

训练完我们的网络后,我们可以在等待测试的集合上收听模型的性能。看看您是否能区分输出A和输出B(您可能需要戴耳机)。

我们发现,该模型能够再现与真实模拟踏板几乎无法区分的声音。最棒的是,该模型体积小,效率高,可以实时使用。使用这项技术,许多模拟效果踏板很可能只需要几分钟的音频样本就可以建模。

一如既往的感谢您的阅读!有关这篇帖子或其他帖子的任何问题,请随时在Twitter上联系:@teddykoker。

亚历克·赖特等人,“基于深度学习的实时吉他放大器仿真”,“应用科学”第10卷,第3期(2020年):766.↩。

Christian Kehling等人,“通过估计乐谱和乐器相关参数,电吉他录音带的自动转写”。在DAFx,2014年,219年至26年。↩

Aaron van den Oord等,“WaveNet:a Generative Model for raw Audio”,arxiv预印本arxiv:1609.03499,2016年。-↩